Il y a un an et demi, une liste de clients fuitée établissait que divers services de police et gouvernementaux recouraient à Clearview AI, y compris en Belgique. La nouvelle fut en son temps démentie par la Police Fédérale (voir notre article). Un porte-parole avait à l’époque déclaré qu’à sa connaissance, ce logiciel n’avait jamais été utilisé, qu’il n’y avait aucune preuve qu’il en soit ainsi et qu’on n’envisageait pas de recourir à Clearview AI. Cela apparait comme un mensonge.

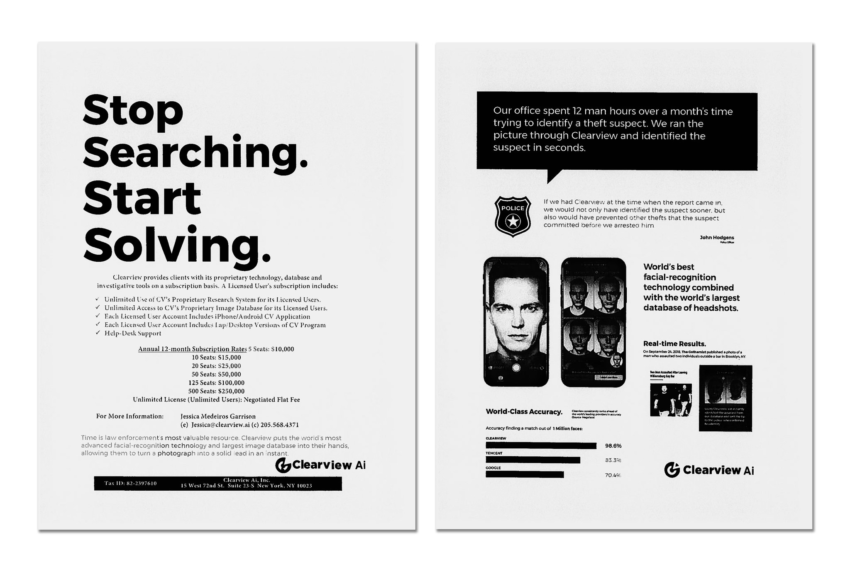

En réaction à quelques questions parlementaires, la ministre de l’intérieur a confirmé que le logiciel de reconnaissance faciale illégal a quand même été utilisé. « En octobre 2019, deux enquêteurs, dans le cadre d’une taskforce Europol d’identification de victimes, ont eu accès à une licence d’essai valable une durée limitée », a reconnu la ministre à la Chambre. Elle insiste cependant sur le fait qu’il ne s’est pas agi d’une utilisation structurelle du logiciel (il s’agirait de « test ») et que la loi belge ne le permet du reste pas. Clearview a collecté et collecte des milliards d’images d’Instagram, Facebook, Twitter et YouTube entre autres et peut ainsi par exemple aisément relier une caméra de surveillance à une identité ou à un profil sur des médias sociaux. Or ces images sont collectées sans autorisation. Aux Etats-Unis notamment, l’entreprise a déjà été mise en accusation, et au Canada, le contrôleur national de la confidentialité déclare que ClearView enfreint la loi (voir notre article).