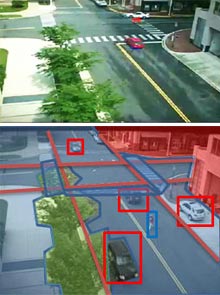

A l’exemple de YouTube et toutes les sources en plein développement de vidéos, presque toute les recherches d’images ou de vidéo sont faites en utilisant le texte environnant. Le nouveau système, appelé I2T, est destiné à changer cela. Il met en oeuvre une série d’algorithmes de vision informatiques dans un système qui intègre des images ou des cadres vidéo et produit des résumés de ce qu’ils dépeignent. Ce prototype peut produire une description vivante d’événements à partir d’images. Non encore prêt pour l’utilisation commerciale, le logiciel a été développé par des chercheurs à l’Université de la Californie, Los Angeles, en collaboration avec ObjectVideo de Reston. Ce logiciel ouvre naturellement de nouvelles perspectives à la vidéosurveillance.

La première partie d’I2T est un analyseur syntaxique d’image qui décompose/analyse une image, en utilisant le travail, commencé en 2005, de l’Institut de Lotus Hill situé dans le Ezhou, en Chine. Cet institut a recruté environ 20 diplômés d’écoles des beaux-arts locales pour travailler à plein temps à annoter une bibliothèque d’images pour aider des systèmes de vision informatiques. Le résultat est une base de données de plus de deux millions d’images contenant les objets qui ont été identifiés et classés dans une hiérarchie de 500 catégories basées sur la base de données WordNet de Princeton.