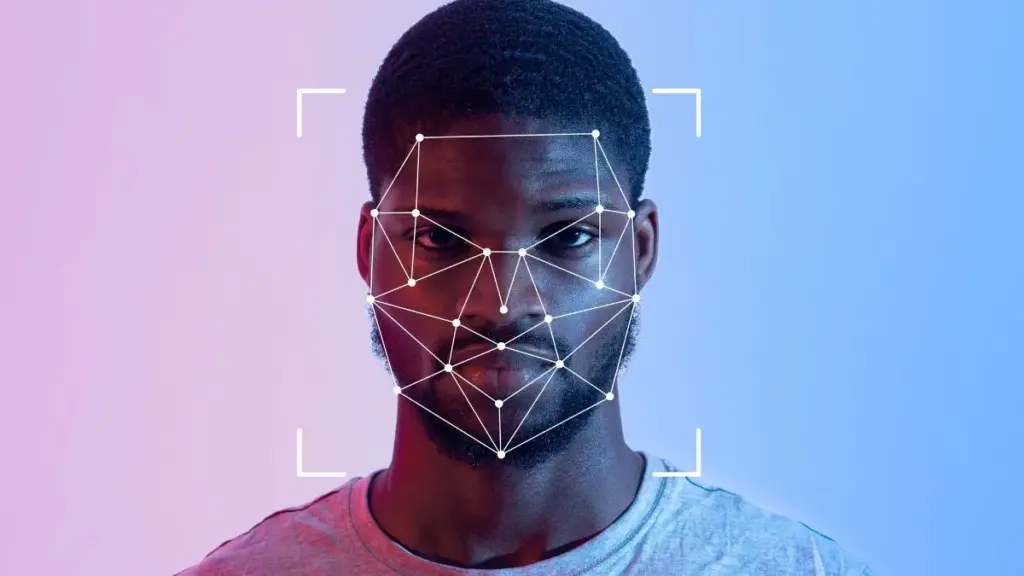

Des chercheurs ont découvert que le frontend (l’interface web normalement réservée aux employés et non visible du public) du prestataire de vérification d’identité Persona Identities, Inc., utilisé par Discord pour vérifier l’âge de ses utilisateurs, était exposé sur internet, c’est-à-dire accessible publiquement alors qu’il n’aurait pas dû l’être. Cette interface, maintenant retirée, contenait 2 456 fichiers montrant l’ampleur des contrôles effectués : jusqu’à 269 vérifications différentes, analyses faciales contre des listes de surveillance et de personnes politiquement exposées, contrôle de “médias défavorables” (terrorisme, espionnage…) et attribution de scores de risque. Persona peut collecter et conserver pendant trois ans des informations personnelles telles que adresses IP, empreintes de navigateur et d’appareil, pièces d’identité, numéros de téléphone et analyses biométriques de selfies. Cette révélation alimente le débat sur la protection de la vie privée et l’efficacité réelle de la vérification d’âge. Discord aurait indiqué ne plus recourir à Persona, mais d’autres plateformes comme Roblox Corporation, OpenAI (pour ChatGPT) et Lime utilisent encore ses services.

Dossier(s): Techniques et technologies Tags: Internet, Sécurité IT