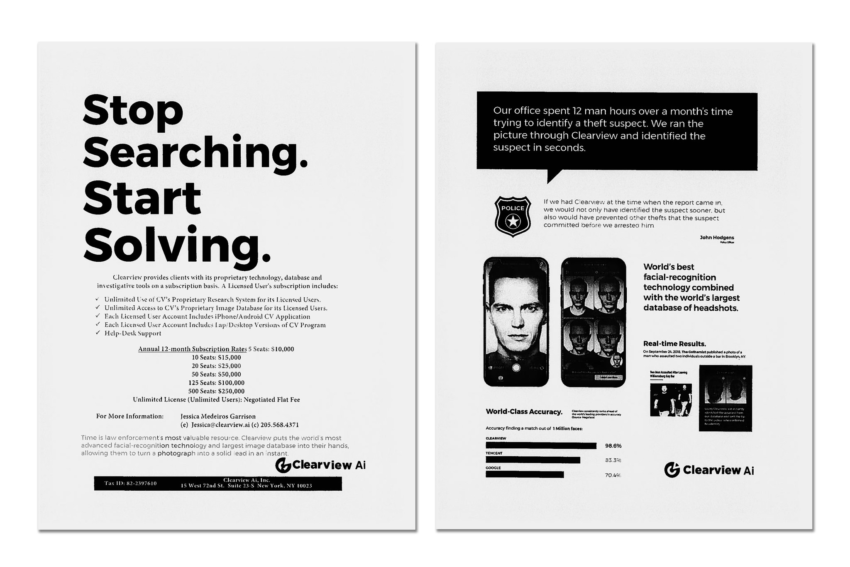

Depuis sa fondation en 2017, l’entreprise Clearview AI moissonne des photos sur le web, et notamment les réseaux sociaux, afin d’alimenter un gigantesque système de reconnaissance faciale. Dans une interview, son PDG a affirmé que la firme aurait passé plus de 10 milliards d’images au crible, et développerait en ce moment de nouveaux outils basés sur l’IA pour les exploiter. En l’occurrence, il s’agirait d’outils de “défloutage” et de “suppression de masque”. Deux concepts qui présentent un point commun : il s’agit d’extrapolations basées sur des données incomplètes. Avec ces nouveaux outils, Clearview AI semble donc plus intrusif que jamais, mais aussi moins fiable, paradoxalement. Clearview AI est utilisé ou a été utilisé par des agences fédérales américaines et des forces de police (dont la police belge, voir notre article) mais aussi des compagnies privées comme Walmart, la NBA ou des opérateurs télécoms majeurs.

Dossier(s): Techniques de la répression Tags: Technique de répression

Campagne à propos des photos dans les manifestations

Campagne à propos des photos dans les manifestations Campagnes de soutien médical aux combattant·es du Rojava

Campagnes de soutien médical aux combattant·es du Rojava